Video: Hvad er definitionen af entropi i beslutningstræet?

2024 Forfatter: Lynn Donovan | [email protected]. Sidst ændret: 2023-12-15 23:45

Entropi : A beslutningstræ er bygget ovenfra og ned fra en rodknude og involverer opdeling af data i undersæt, der indeholder instanser med lignende værdier (homogen). ID3 algoritme bruger entropi at beregne homogeniteten af en prøve.

Folk spørger også, hvad er definitionen af entropi i maskinlæring?

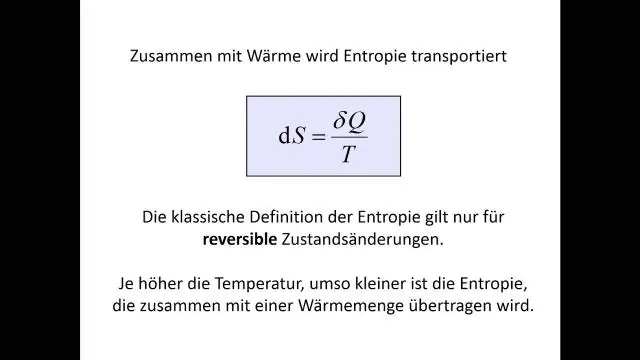

Entropi , som det vedrører maskinelæring , er et mål for tilfældigheden i de oplysninger, der behandles. Jo højere entropi , jo sværere er det at drage nogen konklusioner ud fra den information. At vende en mønt er et eksempel på en handling, der giver information, der er tilfældig. Dette er essensen af entropi.

Udover ovenstående, hvad er informationsgevinst og entropi i beslutningstræet? Det informationsgevinst er baseret på faldet i entropi efter et datasæt er opdelt på en attribut. Konstruktion af en beslutningstræ handler om at finde den egenskab, der returnerer højest informationsgevinst (dvs. de mest homogene grene). Resultatet er Informationsgevinst eller fald i entropi.

Ved også, hvad er minimumsværdien af entropi i et beslutningstræ?

Entropi er laveste i yderpunkterne, når boblen enten ikke indeholder nogen positive forekomster eller kun positive forekomster. Det vil sige, når boblen er ren, er lidelsen 0. Entropi er højest i midten, når boblen er jævnt fordelt mellem positive og negative forekomster.

Hvad er entropi i tilfældig skov?

Hvad er entropi og hvorfor informationsgevinst betyder noget Afgørelse Træer? Nasir Islam Sujan. Jun 29, 2018 · 5 min læst. Ifølge Wikipedia, Entropi henviser til uorden eller usikkerhed. Definition: Entropi er målene for urenhed, uorden eller usikkerhed i en række eksempler.

Anbefalede:

Hvad er definitionen af kvalitative og kvantitative observationer?

Det involverer observation af alt, der kan måles, såsom forskelle i former, størrelser, farve, volumen og tal. Kvalitativ observation er en subjektiv proces til at indsamle data eller information, mens kvantitativ observation er en objektiv proces til at indsamle data eller information

Hvordan fungerer beslutningstræet i R?

Beslutningstræ er en type overvåget læringsalgoritme, der kan bruges i både regressions- og klassifikationsproblemer. Det virker for både kategoriske og kontinuerlige input- og outputvariabler. Når en underknude opdeles i yderligere undernoder, kaldes den en beslutningsknude

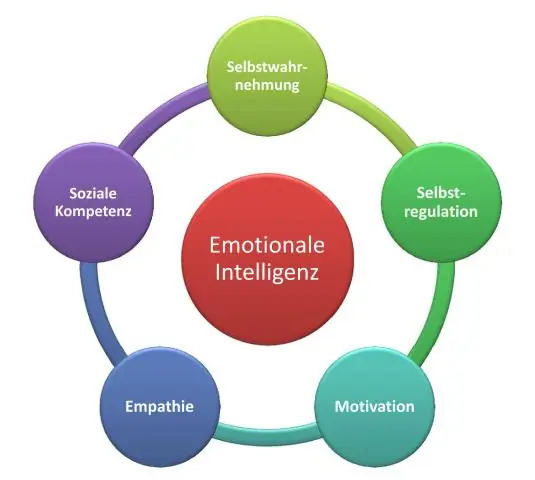

Hvad er definitionen af intelligens i psykologi?

Intelligens er evnen til at tænke, til at lære af erfaringer, til at løse problemer og tilpasse sig nye situationer. Psykologer mener, at der er en konstruktion, kendt som generel intelligens (g), der forklarer de overordnede forskelle i intelligens blandt mennesker

Hvad er entropi i tekstmining?

Entropi er defineret som: Entropi er summen af sandsynligheden for hver etiket gange log-sandsynligheden for den samme etiket. Hvordan kan jeg anvende entropi og maksimal entropi med hensyn til tekstmining?

Er beslutningstræet en regression?

Beslutningstræ - regression. Beslutningstræ bygger regressions- eller klassifikationsmodeller i form af en træstruktur. Den øverste beslutningsknude i et træ, som svarer til den bedste forudsigelse kaldet rodknude. Beslutningstræer kan håndtere både kategoriske og numeriske data